blog

Algoritmes bij gemeenten: hoe verstandig om te gaan met de data van de burgers?

Er zijn veel ontwikkelingen op het gebied van digitalisering en datagedreven werken. We moeten heel veel (denk aan alle privacy en security regels), maar we willen en kunnen ook heel veel. Maar moeten we ook alles wat we kunnen wel willen? Dat is een hele andere vraag… Dat is waar het om draait als we kijken naar het gebruik van algoritmes. In dit blogartikel gaan we dieper in op het gebruik van algoritmes en verantwoord datagebruik bij Nederlandse overheidsinstanties.

Wat is een algoritme?

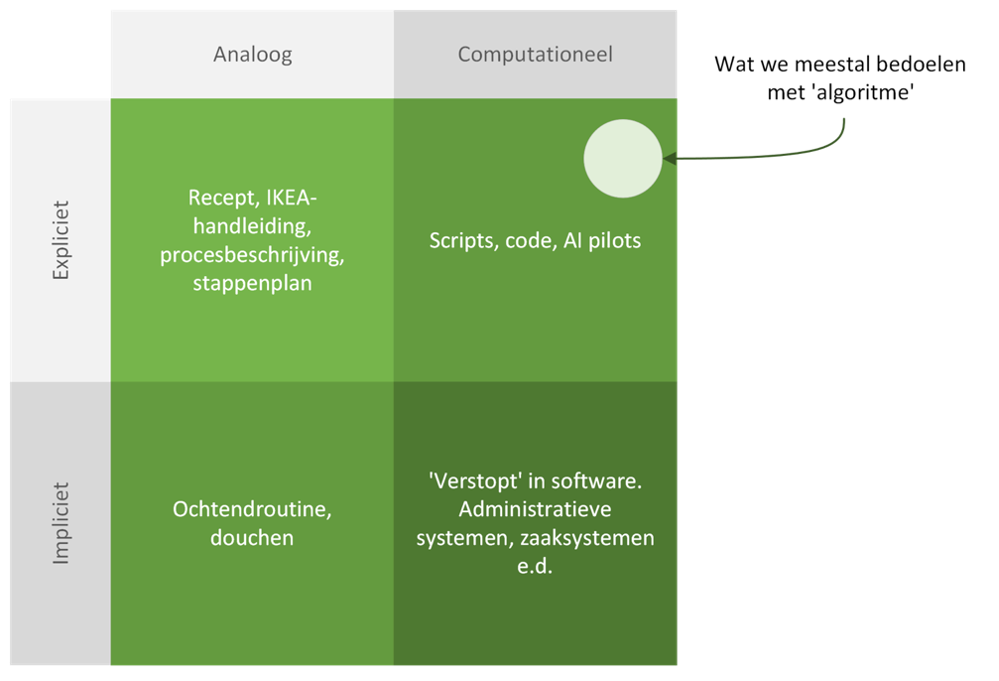

De meeste mensen denken bij een algoritme meteen aan complexe computerberekeningen, maar een algoritme hoeft helemaal niet computergebonden te zijn. Je komt algoritmes overal tegen, in je kookboeken, in de handleiding van je nieuwe IKEA Billy boekenkast, je routeplanner, in ieder softwarepakket wat je gebruikt (code bestaat ook uit algoritmen) en ook online wanneer je op het internet surft. Wat houdt een algoritme dan in?

Het woord algoritme is een verbastering van de naam van een Perzische wiskundige, namelijk Mohammed ibn Moesa al-Chawirizmi. Hij schreef in de negende eeuw een boek over het uitvoeren van berekeningen. Zijn werk werd vertaald in het Latijns waarin hij ‘Algoritmi’ (Al-Chawirizimi = algoritmi) werd genoemd. Voorheen werd de term ‘algoritme’ gebruikt voor berekeningen met cijfers, maar inmiddels gaat de term verder dan dat. Er zijn verschillende definities voor een algoritme. In dit artikel zien wij een algoritme als een stappenplan dat je helpt om een bepaald resultaat of doel te behalen.

Vandaag de dag gebruiken we de term ‘algoritme’ vooral voor door computers uitgevoerde algoritmes. Alleen, zo’n instructie of stappenplan doet op zichzelf helemaal niets. Het dient ingezet te worden door mensen in een bepaalde context. Anders blijft het bij puur een stuk technische code. Door het in te zetten binnen organisaties en werkpraktijken gebeurt er ook daadwerkelijk iets met deze ‘technische code’.

Eigenschappen van algoritmes

Nu we al iets beter weten hoe divers algoritmes kunnen zijn en zien dat je algoritmes dagelijks tegenkomt (zelfs als je het niet verwacht!), zoomen we verder in op de eigenschappen. Een algoritme heeft drie eigenschappen. We bekijken deze eigenschappen met een bril op die rekening houdt met de samenleving.

1. Algoritmes en data zijn niet neutraal.

Vaak wordt er gedacht dat data of algoritmes neutraal zijn en objectief gemaakt of verkregen zijn. Echter, data zijn altijd ‘gemaakt’ door iemand voor of met een specifiek doel. Dit geldt ook voor algoritmes. Denk maar aan het voorbeeld van data die verzameld is en gebruikt is in een algoritme om fraudeurs op te sporen. Er is bepaald welke data relevant zijn en hoe deze gebruikt kan worden om tot een bepaalde uitkomst te komen: een fraudeur opsporen. Hierover is nagedacht en op deze manier is zowel de data als het algoritme ‘gemaakt’.

2. Algoritmes zijn tijdsgebonden.

Algoritmes worden gecreëerd in een specifieke tijd met een specifiek doel. Daarbij worden er afwegingen gemaakt op basis van waarden, normen, keuzes en politieke factoren. Alleen wordt er niet gekeken naar de toekomst en hoe de algoritmes hier ook in moeten passen. Politieke waarden en normen die de huidige gemeenteraad, het college en het coalitieakkoord belangrijk vinden, kunnen bij een volgende verkiezing heel anders worden geïnterpreteerd.

3. Algoritmes zijn gebaseerd op aannames.

Bij het creëren van algoritmes worden er aannames gedaan door de betekenis die wordt gegeven aan datapunten. Die zijn achteraf moeilijk te veranderen als bij het creëren van algoritmes daar geen rekening mee gehouden wordt. Zo kan blijken dat je gecreëerde algoritme erg discriminerend is en dat je daar van tevoren nooit over na hebt gedacht. Een voorbeeld hierbij is dat er vastgesteld wordt dat een X aantal tandenborstels in huis betekenis geeft aan hoeveel mensen er in huis wonen. Maar is dit ook echt zo?

Algoritmes zijn daarmee complex en dus moet er heel zorgvuldig omgegaan worden met algoritmes en met alle data die door die algoritmes wordt geraadpleegd om ervoor te zorgen dat het algoritme ook op de juiste manier wordt ingezet en zonder vooroordelen daadwerkelijk bijdraagt aan het doel.

De kansen van algoritmes bij gemeenten

Het combineren van data in geautomatiseerde algoritmes kan ervoor zorgen dat er efficiënter gewerkt wordt. Zo kan er werk uit handen worden genomen van ambtenaren, wat veel tijd scheelt, zodat deze uren besteed kunnen worden aan andere (meer gecompliceerde) taken. Denk bijvoorbeeld aan de Belastingdienst die checkt of een betaling is gedaan volgens de afgesproken betaaltermijn van een betaalregeling. Is er niet betaald? Dan dient er een herinnering of aanmaning verstuurd te worden naar de specifieke burger. Een algoritme kan deze taak uit handen nemen van een ambtenaar, zodat deze meer tijd overhoudt voor bijvoorbeeld het telefonische contact met wanbetalers. Of voor het zoeken naar een oplossing voor de schulden die nog vereffend dienen te worden.

Het gebruik van algoritmes zorgt niet alleen voor een efficiëntere afhandeling van administratieve taken, maar er blijft dus ook meer tijd over bij de werknemers van een organisatie om andere taken uit te voeren. Algoritmes helpen om sneller informatie te verwerken en ingewikkelde keuzes te maken. Ook kan een algoritme patronen halen uit data om zo beter verbanden te kunnen leggen tussen omstandigheden. Het gebruik van algoritmes kan het werk van organisaties dus vergemakkelijken.

Nadenken over de risico’s

In dit artikel beschreven we al eerder dat er zorgvuldig met algoritmes moet worden omgegaan om zo echt de voordelen van het werken met algoritmes te ervaren. Het is belangrijk om als organisatie deze vraag te stellen: wanneer worden algoritmes nu echt spannend?

Wanneer je start met het werken met algoritmes – of simpelweg de algoritmes die al in werking zijn in kaart brengt – is het aan te raden om eerst heel goed na te denken. Welke definitie van een algoritme hanteer je? Wat is het gewenste doel van het algoritme, wat moet het algoritme opleveren? En welke aannames kunnen er in de data verstopt zitten? Geautomatiseerde systemen repliceren vaak menselijke vooroordelen en tekortkomingen. Juist doordat we denken dat een geautomatiseerd algoritme altijd (automatisch) objectief is, slaan we deze belangrijke stap over.

De beslissingen over algoritmes moeten gebeuren op twee niveaus – enerzijds projectgerelateerd en anderzijds organisatorisch. Voor dat ene project kan het inrichten van een algoritme veelbelovend zijn, maar hoe is dit organisatiebreed? Pas als je naar deze twee niveaus kijkt, kun je beoordelen welke risico’s algoritmes en het vergaren van data met zich meebrengen en of deze risico’s acceptabel zijn.

Is het acceptabel dat door het automatiseren van de betalingsregeling rondom een gemeentelijke belastingschuld bepaalde mensen hun betalingsregeling ontzegd wordt omdat zij niet op tijd betalen of niet het juiste bedrag betalen? Mensen met dyscalculie kunnen een vergissing maken in het te betalen bedrag en door deze automatisering hun betalingsregeling verliezen. Is dit het risico waard, alleen om een aantal uren werk op de afdeling te besparen? En is het wel “eerlijk” om als gemeente deze groep mensen op deze manier te benaderen? Impliciet zeg je dat iemand zich niet kan vergissen, maar dat er altijd kwade opzet is.

Het is belangrijk om als organisatie goed in kaart te brengen en vast te leggen wat een geaccepteerd risico is en wanneer de risico’s te hoog zijn om een algoritme in werking te zetten.

De komende AI Act

Gelukkig komt er ook steeds meer regelgeving die zich richt op de risico’s van automatisering van data in algoritmes. Zo is Europa bezig met de AI Act die gericht is op verantwoord gebruik van Artificial Intelligence, inclusief algoritmes. In deze regelgeving wordt social scoring verboden. Social scoring gebeurt wanneer je als individu een hogere score krijgt toegewezen wanneer je gewenst gedrag vertoont, zoals het op tijd betalen van je belasting of het niet door rood lopen bij een stoplicht. Dit datagebruik wordt verboden in de komende AI Act.

Daarnaast worden er hoog risico’s geclassificeerd voor AI-toepassingen. Voor nu is het bekend dat er twee soorten hoog risico’s worden onderscheiden. Namelijk AI-toepassingen waarvoor een self assessment verplicht is en AI-toepassingen die door een externe instantie op conformiteit getoetst moeten worden. De kredietcheck die momenteel door organisaties wordt toegepast in Nederland valt straks in de klasse ‘hoog risico’ wanneer de AI Act van kracht is.

Het algoritmeregister

In eigen land zijn er ook ontwikkelingen op het gebied van regelgeving. Het kabinet heeft een motie aangenomen dat er een centraal algoritmeregister moet komen voor de Nederlandse overheid. Zo kunnen de algoritmes wettelijk worden gecontroleerd op discriminatie en willekeur. Daarnaast kunnen de registraties van de algoritmes zo door iedereen bekeken worden op één centrale plek. Op dit moment hebben een aantal overheidsorganisaties al algoritmes gepubliceerd in dit register. Uiteindelijk wordt het algoritmeregister wettelijk verplicht.

Daarnaast zijn er nog meer ontwikkelingen op het gebied van (internationale) regelgeving om zo te waarborgen dat er verstandig en bewust wordt omgegaan met de data van burgers.

Datagedreven werken

Steeds meer overheidinstanties omarmen datagedreven werken. Dit houdt in dat zij door middel van data (betere) keuzes kunnen maken. Zoals al eerder genoemd is data meestal niet objectief, want data wordt ‘gemaakt’ en gebruikt voor specifieke doeleinden. Hoe ga je verantwoordelijk om met de data van de Nederlandse burger?

Het goede antwoord is: door met elkaar in gesprek te gaan over het datagebruik en hier samen beslissingen in te maken.

Vind je het lastig om in je organisatie dat gesprek te beginnen of weet je niet waar je beginnen moet? Parell helpt je graag verder. Wij ondersteunen diverse Nederlandse gemeenten bij datagedreven werken op een scala aan onderwerpen. Zo kunnen wij helpen bij algoritme governance, het opzetten van een algoritmeregister, advies over verantwoordelijk datagebruik, alles over privacy aspecten rond data en informatiebeveiliging.

Of boek eerst de training ‘Algoritmisering’ waarin we in 4 sessies een globaal plan van aanpak & roadmap opstellen samen met jouw organisatie.

Geïnteresseerd? Bel onze collega’s of e-mail voor meer informatie:

Henk Wubs | 06 29 52 85 31 | henk.wubs@parell.nl

Eric de Kruik | 06 24 17 12 82 | eric.dekruik@parell.nl